Фильтры Яндекса и Google — за что можно получить пессимизацию или бан от поисковых систем

Эта статья является логическим продолжение публикации на тему повышения релевантности и улучшения ранжирования, с которой вы можете ознакомиться по приведенной ссылке. Сегодня я хочу поговорить о фильтрах, которые имеют место и в Гугле, и в Яндексе, а так же поделиться собственным примером попадания под один из них.

На самом деле оптимизация сайта под поисковые запросы — это, по большому счету, ходьба по лезвию бритвы. Причем все те действия, что совсем недавно не вызывали у российских поисковиков никаких нареканий, могут с течением времени стать причиной наложения фильтра или даже попадания в бан. Во второй половине статьи я опишу свою печальную историю об общении с техподдержкой Яндекса на предмет попадания KtoNaNovenkogo.ru под фильтр за переоптимизацию, ну, а пока немного теории.

Пессимизация и фильтры при ранжировании (продвижении)

Все описанное выше было бы очень здорово, если бы у поисковиков не было такой вещи как пессимизация и фильтры, которые способны существенно понижать в выдаче даже высоко релевантные запросу сайты. Для чего нужны поиску эти инструменты?

Ну, очевидно, что для отсева различных вариантов накрутки и переспама описанных чуть выше факторов ранжирования. Те же самые тексты можно так забить ключевыми словами для якобы повышения соответствия поисковому запросу, что на документ будет наложен соответствующий фильтр, позволяющий алгоритму исключить такой документ из индекса или же серьезно понизить его релевантность. Тоже самое относится и к переспаму анкор листов и накрутке поведенческих факторов.

Пессимизация и фильтры (или бан) — это инструменты поисковых машин для борьбы с накрутками и спамом. Они последнее время очень сильно нацелены на то, чтобы бороться с попытками манипуляций с факторами продвижения и попытками улучшения значения формулы релевантности для своего ресурса. Поисковики стараются не допускать и бороться с искусственным воздействием на формулу и все используемые ими способы пессимизации можно разделить на две категории:

Фильтры, накладываемые еще до начала построения формулы ранжирования для вашего сайта. В этом случае поисковики снижают влияние или полностью обнуляют для вас некоторые факторы, тем самым существенно снижая ваши шансы попадания в Топ выдачи. Например, при активных попытках манипуляции с входящими ссылками, могут обнулить значение ссылочных динамических факторов (ссылочное или анкорное влияние) для вашего ресурса (не учитывать ссылки вообще).

После наложения такого предварительного фильтра, тем не менее, к вашему ресурсу будут применяться стандартные формулы ранжирования, но за счет нулевого (или пониженного) значения одного из факторов, место вашего сайта в поисковой выдаче будет не соответствовать реальной релевантности документа. Пессимизация во все красе.

Давайте рассмотрим несколько примеров, показывающих, за что могут быть наложены фильтры (пессимизация):

Аффилированность сайтов — иногда оптимизаторы (или владельцы бизнеса) идут на то, чтобы захватить как можно больше мест в Топе поисковой выдачи и тем самым перехватить как можно больше целевых посетителей (потенциальных клиентов). Сделать это не так то просто, т.к. в результатах поиска обычно отображается только один документ с каждого ресурса (наиболее релевантный запросу). Но выход есть.

Создается еще один или несколько ресурсов помимо основного и их тоже начинают усилено продвигать по тем же поисковым запросам. В результате, в Топе результатов поиска может присутствовать несколько сайтов одного и того же владельца (фирмы). Поисковикам такая ситуация не нравится и при обнаружении такой попытки повлиять на ранжирование, они накладывают фильтр за аффилированность, в результате действия которого в выдаче остается только один ресурс, а остальные начинают считаться его зеркалом.

Что примечательно, этот фильтр работает не всегда корректно и именно благодаря ему появился способ борьбы с конкурентами, который позволяет убедить поиск в том, что ваш сайт аффилирован с ресурсом вашего конкурента, но поиск предпочтет, в силу ряда причин, оставить в выдаче именно ваш ресурс, выкинув конкурента не только из Топа, но и вообще из результатов поиска по данному запросу.

Фильтр на одинаковые сниппеты — если у нескольких сайтов в результатах поиска по определенному запросу будут до некоторой степени одинаковые сниппеты, то будет показываться только один из них. Причем, не факт, что останется более релевантный документ.

Наверное, данный фильтр наиболее актуален для интернет магазинов, которые зачастую имеют одинаковые описания товаров (а они могут использоваться в качестве сниппета) взятые с ресурсов производителей.

Портяночный фильтр — переоптимизированные тексты, где чрезмерно высоко количество употреблений ключевых слов. Этот фильтр зависит от конкретных запросов (в основном применяется к коммерческим) и на его наложение или неналожение может повлиять авторитетность ресурса.

Например, в случае коммерческого запроса и пятидесяти вхождений ключа в тексте документа, вы гарантированно попадаете под портяночный фильтр и релевантность вашего документа уменьшится на величину штрафа (кстати, очень большого, способного отбросить ресурс за первую сотню в выдаче).

Для того, чтобы исключить наложение портяночного фильтра, достаточно будет:

Фильтр за переоптимизацию — направлен против манипулирования текстовыми факторами ранжирования и попытки оказать влияние на релевантность документа. Отличается от портяночного тем, что штраф накладывается не за количество употреблений ключевых слов в тексте.

Данный фильтр применяется практически исключительно для коммерческой выдачи и не привязывается к конкретному поисковому запросу, т.о. если он накладывается на документ, то веб страница понижается по всем запросам, по которым она продвигалась. Причем, штраф (пессимизация) при наложении этого фильтра будет меньше, чем при наложении портяночного (пару десятков позиций, т.е. просто выкидывается сайт из топа)

Покупные Seo ссылки — поисковики умеют определять покупные бэклинки с большой долей вероятности, но коммерческие ссылки не всегда есть зло с точки зрения поиска, ибо зачастую проставляются они с качественных и авторитетных ресурсов. Покупные линки по коммерческим запросам могут положительно влиять на ранжирование и увеличивать релевантность документа.

Другое дело, когда вы попытаетесь продвигать информационные запросы при помощи закупки ссылочной массы, то это будет просто пустая трата денег и времени. Получается своеобразный запросозависимый ссылочный фильтр.

Повышая релевантность можно попасть под фильтр

Вот именно о тех неправедных способах повышения соответствия страниц своего сайта требованиям поисковиков, которые могут привести к совершенно обратному эффекту (сильному понижению позиций в поисковой выдачи — наложению фильтра, пессимизации или бану), мы и поговорим в этой статье.

Причем, ничего выдумывать сам я не буду, да и не зачем это делать. Ведь поисковики обязаны прикрыться фанеркой и подробно описать все запрещенные и караемые способы повышения релевантности и воздействия на ранжирование.

В общем, спросим у первоисточника — за что можно получить в лоб, а что можно применять без особой опаски для небольшой корректировки и улучшения позиций сайта в выдаче. Давайте спросим о сокровенном у Яндекса (поддержим отечественного производителя), ибо он все же является лидером в России. Итак, интервью у хелпа Яндекса по поводу допустимых и недопустимых способов улучшения ранжирования.

Хотя, нет. Сначала напомню вам те способы легитимного воздействия на релевантность, о которых я уже неоднократно говорил. Кроме уже упомянутой чуть выше оптимизации текстов под нужные поисковые запросы (Самостоятельная раскрутка и продвижение сайта), наверное, прежде всего стоит сообщить поисковикам о существовании своего веб проекта — добавить Url своего сайта в аддурилку Яндекса и др. поисковых систем.

На ранжирование очень сильно влияет такое понятие, как траст, а поднять его можно обратными ссылками с трастовых ресурсов. Поэтому было бы не плохо попытаться добавить сайт в Яндекс каталог, Dmoz и другие трастовые и авторитетные каталоги. Вообще, все это я уже неоднократно обсуждал и писал, поэтому попробуйте сами поискать ответы в публикации Как раскрутить сайт самому.

Ну, это так, для общего сведения, а сейчас, наверное, пора переходить к перечислению запретных способов манипуляции релевантностью веб документов, в частности, Яндекса. Дело в том, что поисковые системы могут не только повышать или понижать уровень соответствия страниц наших сайтов запросам поиска, но и могут применять санкции и вносить их в черные списки, в случае, если они посчитают, что мы их пытаемся обмануть (описанные выше фильтры и баны).

В лицензии поиска такие моменты очень подробно описаны, чтобы к ним не было по этому поводу никаких претензий. Например, в лицензии на использование поисковой системы Яндекса довольно подробно описано про ранжирование:

В первом абзаце лицензии говорится, что оно осуществляется, как и следовало ожидать, на основе определения релевантности страницы поисковому запросу, но делается акцент на то, что она определяется не предвзято с помощью программы, причем, настройки этой программы могут постоянно меняться и, следовательно, ваш ресурс может совершенно спокойно скакать в выдаче с одного места на другое по мере изменения алгоритмов и ничего вы с этим поделать не сможете.

В третьем абзаце пункта 3.4 Яндекс как раз говорит о том, что для него и любой другой поисковой системы главное это интересы пользователя, а не авторов веб проектов (по которым осуществляется поиск), чтобы сразу же в корне пресечь все попытки вебмастеров апеллировать к Яндексу с вопросами о не справедливом и не правильном расчете релевантности по тому или иному запросу (мой ресурс такой хороший, а вы его в конец очереди…).

В первом предложении пункта 3.5 как раз описано то, чем занимаются все SEO оптимизаторы (как начинающие, так и продвинутые) — обманом и спамом (искусственное завышение релевантности страниц для улучшения позиций). При этом Яндекс грозит нам фильтрами (ухудшением позиций — пессимизация сайта), либо вообще баном (полным исключением ресурса из индекса и, соответственно, поиска).

Во втором абзаце этого пункта лицензии написано, что о факте понижения в ранжировании (наложении фильтра или забанивания) вам никто специально не сообщит и возможностей выхода из под фильтра вам никто не гарантирует.

Хотя, на самом деле, при корректном общение с «Платоном Щукиным» (так обычно подписываются операторы службы поддержки Яндекса) можно будет выяснить и причину понижения в выдаче, и решить проблему с выходом из под фильтра (полностью банят ресурс сейчас крайне редко). Правда, нервов и времени уйдет на это предостаточно.

Далее Яндекс говорит, что не обязан отчитываться за что именно вас забанили или понизили в выдаче, тем более, что со временем могут появляться все новые и новые методы спама, за которые можно будет угодить под фильтр. Но зато он приводит ссылку на весьма полезный документ — Чем отличается качественный сайт от некачественного с точки зрения Яндекса, который следует изучить со всем тщанием. Давайте вкратце пробежимся по его ключевым моментам, чтобы понимать чего не следует ни в коем случае делать в погоне за повышением релевантности.

За что пессимизирует сайты Яндекс

В разделе «Основные принципы» говорится о том, какие ресурсы он хотел бы видеть в своем индексе. Тут нас «агитируют за советскую власть» — советуют использовать только оригинальный контент, продумывать юзабилити, не проставлять ссылки на страницах своего проекта за деньги, а так же думать прежде всего о посетителях (т.е. создавать нужно именно СДЛ) и не пытаться продвигаться по тем поисковым запросам, по которым на страницах нашего ресурса не будет исчерпывающей информации. В общем-то, справедливо, но…

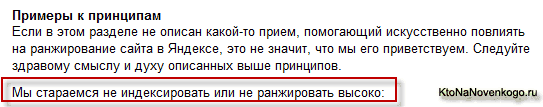

Наверное, это все интересно, но гораздо интереснее то, что написано в разделе «Примеры к принципам» после слов «Мы стараемся не индексировать или не ранжировать высоко».

В первом пункте Яндекс предупреждает, что за не уникальный (скопированный) контент ресурс может быть пессимизирован.

Наверное, небольшой процент не уникального контента не приведет к печальным последствиям, но при переходе определенной грани можно попасть под фильтр и сильно потерять в позициях в выдаче, несмотря на то, что релевантность страниц вашего сайта будет достаточно высокой.

Следующие два пункта кидают камень в огород так называемых дорвеев или доров.

Несколько лет назад было довольно популярным занятием создавать дорвеи, тексты страниц которых генерировались автоматически с простановкой нужного количества ключевых слов. Таким образом эти дорвеи попадали в Топ выдачи по нужным ключевым запросам, но пользователи, переходящие на доры из поисковиков, не видели этот автоматически генерированный бредо-текст, т.к. их автоматически перебрасывало на страницы совершенно другого ресурса, продвигаемого таким образом.

Этот способ продвижения относится к так называемому черному SEO. Сейчас двигаться с помощью дорвеев очень сильно затруднено в связи с очень серьезным отношением к этой проблеме поисковых систем. Доры попросту долго не живут и умирают, так и не успев попасть в Топ поисковой выдачи. Однако, их все равно продолжают клепать, дорвеестроители стараются всегда найти лазейку во все еще довольно крупноячеистой сети поисковиков, в которой они отлавливают кандидатов на отправку в бан или под фильтр.

Дальше Яндекс предупреждает, что в ранжировании будут понижаться сайты, имеющие в своем составе каталоги чего угодно, которые не содержат какой-либо уникальной информации.

В связи с этим становится ясно, что продвижение с помощью прогона по каталогам, которое было популярно несколько лет назад, сейчас уже не работает в силу нахождения всех этих каталогов под фильтрами Яндекса (они искусственно занижены в ранжировании, несмотря на реальную релевантность их страниц). В общем, не создавайте сами ГС каталоги и не прогоняйте по ним свои ресурсы, ибо это абсолютно бесполезно (если не вредно).

Далее следует уже банальность — в выдаче будут понижены ресурсы с невидимым или слабо видимым текстом (белым по белому и т.п.) и ссылками.

Понятно, что если вы чего-то прячете от посетителей (например, портянку текста, напичканную ключевыми словами), то несмотря на высокую релевантность этой страницы продвигаемому запросу, Яндекс все равно не позволит ей высоко подняться в выдаче.

Чуть ниже вы сможете узнать, что даже заключая большой текст с ключами в окошко со скролингом, вы все равно потеряете в позициях за счет попадания под фильтр и последующую пессимизацию (пару лет назад это стало громом среди ясного неба для многих профессиональных сеошников).

Затем он предупреждает нас о недопустимости использования еще одного приема продвижения из области черного SEO — клоакинг.

При использовании клоакинга сайт программируется таким образом, чтобы определять, кто именно осуществляет запрос данной веб страницы — поисковый робот или же браузер пользователя (сделать это не сложно на основе анализа запроса к веб серверу). Соответственно, боту отдается веб страница релевантная нужному запросу, а реальному пользователю показывается совершенно другое содержимое.

В очередном примере того, чего не нужно делать, чтобы не попасть под фильтр, Яндекс предупреждает о недопустимости создания ресурсов, которые предназначены лишь для того, чтобы «лить трафик» на вебсайт какой-либо партнерской программы.

![]()

Очень часто этим занимаются в так называемой «фарме». Несмотря на высокую релевантность страниц таких ресурсов они будут серьезно пессимизированы. Хотя, многие на этом живут, с успехом обходят все препоны, которые расставляют поисковики на их пути, и их сайты не попадают под фильтр.

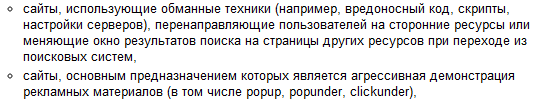

Читая данную «декларацию о намерениях» дальше вы узнаете, что поисковикам не нравятся сайты с вирусами и прочими хитрыми заморочками в настройках серверов, такие ресурсы будут нещадно пессимизироваться невзирая на реальную ценность их страниц для поиска.

Равно, кстати, как и ресурсы, использующие агрессивные способы рекламы с всплывающими окнами (popup, popunder, clickunder). Лично я только за расстрел таких ресурсов из оружия крупного калибра, ибо понижение в выдаче для них уж слишком мягкое наказание — бан и никак не меньше. Вот такой вот я злой, ибо до того как стать вебмастером, я был обычным пользователем и потратил много нервов (сдерживался, чтобы не врезать кулаком по монитору) на подобные сверх раздражающие вещи.

Довольно часто раньше встречался на многих сайтах такой вид спама — «нас находили по таким-то поисковым запросам» и далее следовал список этих самых запросов. Веб сервер собирал эту информацию и выкладывал на данной веб странице запросы в чистом виде, тем самым существенно искусственно повышая релевантность этой страницы.

Вот я раньше попадая на такую страницу очень долго гадал, а чего это меня поисковик на нее привел, когда там нет ответа на мой вопрос (даже намека нет), а только перечисленные фразы, включая ту, которую задавал и я в поисковой строке. Естественно, что такая изгаженная выдача не нравится никому (поисковики теряют на этом лояльных посетителей) и начинают понижать в ранжировании такие ресурсы, загоняя их под фильтры или даже в бан (полное удаление из индекса).

Плагины и расширения, реализующие такой вид спама для увеличения релевантности страницы, можно встретить и сейчас, но упаси вас воспользоваться ими — ни в коем разе, ибо сразу пессимизируют и так понизят в выдаче, что трафика с поисковиков вообще не будет.

Но что обидно, иногда под этот фильтр можно попасть за использование совершенно, казалось бы, безобидного «облака тегов», если поисковик сочтет его за такой вид спама и стремление искусственно повысить соответствие страницы запросам поиска.

Далее Яндекс предостерегает нас от создания нескольких ресурсов для одного владельца (аффилированность):

Есть такой хитрый способ оккупации всего топа поисковой выдачи за счет создания целой когорты сайтов для одной и той же фирмы, которые делаются на разных доменных именах и наполняются разным контентом, с высокой релевантностью нужным запросам. В результате продвижения их выталкивает в топ выдачи Яндекса и Гугла и, в случае большой удачи, весь Топ 10 может быть заполнен ресурсами одной и той же фирмы.

Для данной фирмы это будет неоспоримая удача, но поисковикам такая ситуация кажется неправильной и они всеми силами и средствами пытаются выявить и понизить в выдаче такие дубликаты (аффилиаты). Обычно аффилиаты палятся (попадают под аффилиат-фильтр) на одинаковых контактных телефонах и других признаках принадлежности одному владельцу, но гораздо чаще по «стуку» конкурентов.

Понятно, что поисковикам не интересны спамные форумы и доски объявлений, где любой посетитель может написать все что угодно и поставить любую нужную ему ссылку, и они будут нещадно понижать в ранжировании и фильтровать вплоть до полного исключения из индекса (бана).

Яндексу, равно как и другим поисковикам, очень не нравятся ресурсы, продающие ссылки для накачки релевантности других ресурсов. Продажные ссылки портят стройный алгоритм ранжирования, основанный на ссылочном факторе.

Однако, основному риску попадания под фильтр или в бан подвергаются ресурсы, устанавливающие скрипты бирж ссылок типа Sape, в то же время, как продавать ссылки через «биржи вечных ссылок», подобные описанным ниже, можно практически безболезненно и ничем не рискуя.

Довольно часто, особенно несколько лет назад, для продвижения проектов и получения внешних ссылок использовали так называемые «сателлиты», т.е. группа сайтов, которая создается только лишь для продвижения одного или нескольких ресурсов, путем проставления на него ссылок. Такие вещи сильно не нравятся поисковикам, т.к. создается искусственная накрутка релевантности и сетки сателлитов довольно эффективно выявляют и отправляются под фильтр или в бан.

Практически на любом ресурсе будет присутствовать внутренний поиск. Он может быть реализован средствами используемого движка, а может быть прикручен с помощью скрипта поиска по сайту от Яндекса, либо от Гугла. Но в любом случае страницы с результатами поиска по материалам вашего ресурса не должны попадать в индекс поисковых систем во избежании наложения фильтра.

Как это сделать? Ну, у нас всегда есть под рукой очень сильный инструмент по управлению индексацией сайта — robots.txt.

Фильтр подкрался незаметно

Решил отписать по поводу санкций, под гнетом которых сейчас находится данный блог. Если кто-то посматривал на расположенный внизу правого сайдбара счетчик посещаемости, то, возможно, заметил, что его показатели существенно уменьшились. Началось падение, в общем то, еще давно, в конце апреля 2012 года, и совпало оно с активацией Гугловской сладкой парочки — Панды и Пингвина.

Но тогда все не было так серьезно — фактически просто прекратился рост посещаемости. Количество посетителей с Яндекса планомерно росло и компенсировало проседание в Google. После каждого апдейта Панды (думаю, что угодил я именно под нее) ситуация все более и более усугублялась. Последний раз, в прошлом году, падение в Гугле совпало с практически одновременным ростом в Яндексе аккурат перед новым годом.

Весной Yandex меня радовал и количество ежедневных посетителей, приходящих с этой поисковой системы, неуклонно приближалось к довольно-таки приятной цифре — 10 000. Но вот наступило 3 апреля 2013 года и после очередного апдейта выдачи Яндекса я почувствовал, что ситуация поменялась и не в лучшую для меня сторону.

В первый день KtoNaNovenkogo.ru потерял лишь около полутора тысяч посетителей, но то было лишь начало лавины, которая сойдя вниз оставила мне от щедрот своих (примерно, недели через полторы или две) лишь пятую часть ежедневной аудитории черпаемой из бесконечных закромов зеркала рунета (2 000 переходов).

Естественно, что будучи читателем некоторых SEO блогов и форумов, я решил спросить о причине такого обвала непосредственно у первоисточника (техподдержки Яндекса или, как они обычно подписываются — Платона Щукина). Задать подобный вопрос можно через всем известный и популярный инструмент для вебмастеров от Яндекса (в левой колонке снизу находится ссылка «Задать вопрос о сайте службе поддержки»).

Сформулировал я свой вопрос так:

Здравствуйте!

Заметил, что начиная со вчерашнего дня (3 апреля) на https://ktonanovenkogo.ru дня резко уменьшилось количество посетителей приходящих с Яндекса. Это совпало с очередным апдейтом. Сегодня ситуация еще более ухудшилась.

Не понимаю, что именно могло это вызвать. Вирусов, вроде бы, на сайте нет, новые материалы добавляются регулярно, ресурс был доступен. Возможно, что мне назначили пенальти за какое-то нарушение.

Если это возможно, то поясните, пожалуйста, в какую сторону смотреть и что именно исправлять или изменять.

Спасибо.

На тот момент у меня еще теплилась надежда, что через один или два апдейта все вернется взад, но после ответа техподдержки все иллюзии рассеялись.

Здравствуйте, Дмитрий!

Проверив Ваш сайт, наши алгоритмы нашли страницы, содержание которых может негативно повлиять на ранжирование. На нем были проиндексированы страницы, содержащие списки поисковых запросов, то есть фрагменты текста, предназначенные не для пользователей, а исключительно для продвижения в поисковых системах. В силу того, что по многим запросам Яндекс не может корректно отранжировать такие страницы, Ваш сайт был понижен в результатах поиска.

Если эти элементы страниц не являются жизненно важными для существования ресурса, уберите их, пожалуйста, или измените таким образом, чтобы они были удобны для восприятия пользователями. Так как сайт оценивается комплексно, то рекомендуем проверить как сами тексты, так и теги (в том числе тег title), и ссылки — для алгоритмов все это имеет значение.

Вы можете сообщить нам об изменениях на сайте, и мы проверим, все ли с ним сейчас в порядке.

—

С уважением, Платон Щукин

Служба поддержки Яндекса

Я быстренько пробежался по самым авторитетным сайтам по тематике продвижения (Елены Камской, SeoProfy, Деваки и некоторых других гуру) и понял, что дело может быть не только в высокой тошнотности текстов (перебор ключевых слов, большом кол-ве тегов strong и др), но и возможны варианты с переоптимизированностью заголовков страниц (в Title) и даже слишком насыщенные ключами и просто повторяющимися словами атрибуты Alt и Title в теге IMG имеющихся на сайте изображений.

Память человеческая довольно короткая и весьма избирательная, поэтому мне показалось, что уж тексты то у меня не могут быть переоптимизированы, ибо последнее время за этим тщательно слежу. Другое дело эти самые атрибуты Alt и Title.

Еще в момент начала ведения этого блога я встал на определенные рельсы — описывать в них то, что изображено на картинке так, чтобы она имела шанс высоко ранжироваться в поиске по картинкам и привлекать на статью дополнительный трафик. То, что эта идея была утопической, особенно по отношению к скриншотам на тему далекой от фривольной, я особо и не задумывался.

Мне всегда говорили — не лечи то, что не болело и не чини то, что не ломалось. Именно так я и поступал все эти годы — прописывал с завидным постоянством в атрибутах Alt и Title описание картинок, потому что посещаемость росла, а поменяв что-то можно было навредить этому благолепию.

Но, если в статье четыре десятка изображений, а сама она повествует, допустим, о Яндекс диске, то для каждой картинки нужно указать в атрибутах то, что она, как раз, имеет отношение к этому самому пресловутому Диску.

Получается список из восьми десятков фраз содержащих в той или иной форме «Яндекс Диск». Если поиск учитывает содержимое атрибутов Alt или Title в ранжировании именно текста статьи, то тут получается явный перебор, как раз подпадающий под определение переоптимизации данное поддержкой Яндекса в ответе мне — списки поисковых запросов.

Поняв это и осознав, что никакого трафика по картинкам я сейчас не получаю и никогда не получал раньше (да и не буду получать в будущем), было принято решение избавиться от этих самых атрибутов вообще. Т.е. все их удалить во всех статьях. На это ушло двое суток и было написано очередное обращение к поддержке Яндекса.

Крушение надежд и планы на будущее

Через несколько дней я получил ответ, который вселил в меня одновременно и радость и настороженность, ибо не было дано гарантий выхода из-под фильтра, а только высказано предположение и рекомендация подождать месяц.

Здравствуйте, Дмитрий!

Причина, по которой Ваш сайт был понижен в результатах поиска, была Вами устранена. Окончательно вопрос о снятии санкций будет решен примерно через месяц, после повторной проверки.

В этот период Вы можете вносить любые запланированные изменения . Главное, чтобы на момент проверки был контент, доступный для индексирования. Что касается работ по оптимизации сайта, то с некоторыми нашими рекомендациями на этот счет Вы можете ознакомиться здесь: http://help.yandex.ru/webmaster/?id=1108938

http://company.yandex.ru/rules/optimization/index.xml

—

С уважением, Платон Щукин

Служба поддержки Яндекса

Ну, на самом деле, вы, наверное, уже догадались, что из под фильтра Яндекса мне выйти так и не удалось. Конечно же, я думал, что майские праздники и связанные с этим редкие апдейты увеличили срок ожидания, но, тем не менее, я все же решил уточнить этот вопрос у Платона Щукина и получил повергший меня в глубокую кручину ответ:

Здравствуйте, Дмитрий!

К сожалению, после повторной проверки алгоритмы приняли решение не снимать санкции. Поэтому, пожалуйста, внимательно ознакомьтесь с нашими рекомендациями:

company.yandex.ru/rules/optimization/

Развивайте свой сайт в соответствии с этими рекомендациями и со временем его позиции будут улучшаться.

—

С уважением, Платон Щукин

Служба поддержки Яндекса

Самое печальное, что к этому моменту от KtoNaNovenkogo.ru полностью отвернулся и Google. Толи я еще глубже попал под Панду, то ли он смотрит на Яндекс, и раз тот не считает нужным хорошо ранжировать этот проект, то и он не будет. В общем, кругом одна сплошная печаль и тоска.

Я еще раз написал в техподдержку Яндекса с просьбой снять фильтр вручную, но, естественно, у них нет такой прерогативы и возможности. Но, что меня приятно удивило, ответили на мое, в запале написанное письмо, очень вежливо и даже указали путь, который может привести к выходу из под фильтра:

Здравствуйте, Дмитрий!

Извините за задержку с ответом.

К сожалению, конкретных способов устранения проблемы мы не указываем. Наилучший результат даст коррекция текстов, снижающая избыток ключевых слов.

—

С уважением, Платон Щукин

Служба поддержки Яндекса

Ну, и я решил последовать совету и занялся с недавних пор коррекцией текстов своих статей, начав с конца. Человеческая память действительно избирательна и если последние полтора — два года я старался не злоупотреблять ключами или любыми другими словами-паразитами, то в старых статьях я просто ужаснулся от их количества. Это что-то с чем-то. Если честно, то я и сам себя бы под фильтр загнал за такое безобразие.

Процесс коррекции чудовищно долгий и сложный. Даже если сидеть не отрываясь, то максимум можно почистить три — пять статей в сутки, а их — несколько сотен. В общем, в ближайшие полгода мне есть чем себя занять, но, как ни странно, сам факт очеловечивания текстов приносит удовлетворение, что позволяет заниматься этой рутиной даже с интересом, во всяком случае пока.

Да, забыл упомянуть, в поддержку Гугла я тоже писал с просьбой пересмотреть мой сайт (делается это в недрах Гугл Вебмастера — подать запрос на повторную проверку), на что мне отписались, что ручных фильтров на мой сайт наложено не было и ничем помочь не могут.

Удачи вам! До скорых встреч на страницах блога KtoNaNovenkogo.ru

Источник: ktonanovenkogo.ru